سه خطری که هوش مصنوعی میتواند برای آینده ما داشته باشد

اندرو انجی چهرهای شناختهشده در زمینه هوش مصنوعی است و زمانی گفته بود «هوش مصنوعی برق جدید زمانه ماست.» این قیاس حتما در نگاه اول برایتان عجیب به نظر میرسد. برق در طول صد سال گذشته انرژی مورد نیاز ما در همه صنایع را تامین کرده، به همین خاطر خیلیها فکر میکنند انجی اغراقآمیز سخن گفته است.

شاید همه ما از چگونگی آغاز انقلاب برق آگاه نباشیم، ولی باید بدانیم که این انقلاب هم مثل همه انقلابها پر از اتفاقات خوب و بد بود. نباید فراموش کنیم آنهایی که تاریخ را از یاد میبرند محکوم به تکرار کردن آن هستند.

اتفاقات عجیب و ناگوار تاریخ پیدایش برق در کتابهای تاریخ مدفون شده است. شاید کمی درباره نزاع میان تسلا و ادیسون شنیده باشید. ولی کمتر کسی از خانههایی خبر دارد که به خاطر سهلانگاریها یا اشتباهات علمی در آزمایشات مربوطه در آتش سوخت. و احتمالا عده کمتری میدانند که در آن روزگار ۶۶۰۰ ولت برق را به فیلی به نام تاپسی وصل کردند تا نمایشی سرگرمکننده برای مردم برپا کنند.

گذشتهها گذشته و نمیتوان تاریخ را تغییر داد، ولی باید مراقب «برق جدیدی» باشیم که در حال به وجود آمدن است. ایلان ماسک بارها اعلام کرده که هوش مصنوعی میتواند تهدیدی برای حیات بشریت باشد. وظیفه ماست که باهوشتر، قویتر و جامعنگرتر باشیم، چرا که خطرات جهانی این فناوری میتواند از هر چیزی که در طول تاریخ رخ داده بیشتر باشد. باید حواسمان را جمع کنیم و با احتیاط در این مسیر قدم برداریم.

فناوریها و تسلیحات نظامی همیشه از خطرناکترین ابزارهای تاریخ بشر بودهاند. نیل فریزر در خاطرات خود از آزمایش شبکهای عصبی در دهه ۱۹۸۰ برای شناسایی تانکهای دشمن نوشته است. او میگوید آنها کامپیوتر خود را در دو روز مختلف با اطلاعات مربوط به تانکهای دشمن و درختها آموزش دادند. نتیجه این شد که شبکه عصبی در روزهای ابری به درختها حمله میکرد، چون اطلاعات ارائه شده جانبدارانه بود. این داستان در مجلات بسیاری به عنوان یک داستان اخطارآمیز بیان شده، اما حالا با گذشت چند دهه از آن ماجرا، در وضعیتی قرار گرفتهایم که سرمایه زیادی روانه این حوزه شده و سرمایهگذاران به دنبال توسعه سریع هوش مصنوعی هستند.

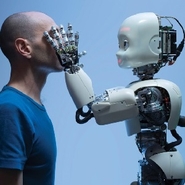

رباتهای آدمکش قصهای برای ترساندن مردم یا افسانهای هالیوودی نیستند، بلکه واقعا وجود دارند. چین بهترین دانشمندان خود را وارد برنامه طراحی سلاحهای AI کرده است. آمریکا و خیلی از کشورهای دیگر نیز شدیدا در حال رقابت با یکدیگرند تا هرچه زودتر به کارکردهای مرگبار هوش مصنوعی دست یابند. شاید تا حالا تصور میکردید که چیزی وحشتناکتر از یک جنگ جهانی اتمی وجود ندارد، اما امروزه دولتها در حال آماده شدن برای همین جنگ هستند. آمریکا میخواهد سرویسهایی از شرکتهای بزرگ تکنولوژی از جمله مایکروسافت را برای اهداف نظامی خود به کار بگیرد، و این اتفاقات نگرانیهای بسیاری به وجود آورده است.

ریسک بعدی خطر کمتری دارد ولی شاید تا به حال به آن فکر نکرده باشید. با توجه به این که دنیای امروز بیش از پیش به فناوری متکی است، کاربردهای نظامی و غیرنظامی هوش مصنوعی میتواند به بحث حملات سایبری نیز کشیده شود. خیلی از ویروسهای کامپیوتری توسط افراد باهوشی نوشته میشوند که میتوانند به نرمافزارشان یاد بدهند که چگونه خود را از سیستمها مخفی کنند. یکی از روشهای شناسایی کرمها و ویروسهای کامپیوتری تشخیص حملات یا رفتارهای خاصی است که از آن برنامه سر میزند.

برای مثال، برخی از تروجانها در زمانهایی که از سیستم استفاده میکنید بیحرکت و بدون هیچ نشانهای آرام میمانند و بعد زمانی که احتمال مشاهده شدنشان کم است به فعالیت میپردازند. حالا چه میشود اگر حملات سایبری به جای برنامهریزی شدن، به طور خودکار از شرایط درس بگیرند و خودشان را با آن تطبیق بدهند؟

کلید مقابله با هجوم این نوع از حملات سایبری استفاده از هوش مصنوعی تطبیقی است. برای این که بتوانیم در دنیای هوش مصنوعی از هکرهای کلاه سیاه جلوتر باشیم، به امنیت سایبری هوشمند نیاز داریم، در غیر این صورت با موج جدیدی از آلودگیهای پیشرفته کامپیوتری مواجه میشویم.

در ۱۰ سال گذشته به سطحی از هوش مصنوعی رسیدهایم که وقتی چت میکنید یا با تلفن حرف میزنید دیگر نمیتوانید تشخیص دهید که دارید با انسان صحبت میکنید یا ربات. شاید کمی به نظرتان عجیب برسد، ولی سیستمهای یادگیری ماشینی امروز میتوانند صدای گویندگان خبر را با مطابقتی تقریبا ۱۰۰ درصدی شبیهسازی کنند. هوش مصنوعی مولد در همین چند وقت اخیر شروع به کار کرده است، بنابراین میتوان پذیرفت که در ۱۰ سال آینده برای مدیریت تعاملات انسانی نیز از هوش مصنوعی استفاده خواهیم کرد.

مت چِسِن برای مجموعه این فناوریها از عبارت اختصاری خاصی موسوم به مدکام (machine-driven communication) استفاده میکند. کارشناس خبرهای در حوزه سیاست را فرض کنید که تواناییهایش ضرب در صد شده باشد. مدکام با استفاده از پروفایل، اثرانگشت آنلاین و روانشناسی پیشرفته شما میتواند به طور مستقیم درباره علایقتان حرف بزند و لحنی داشته باشد که مثال آن را به عمر خود ندیده باشید.

پروپاگاندای رایانشی در حال حاضر به اصطلاحی رایج در حوزه دستکاری اطلاعات با کمک کلان دادهها تبدیل شده است، اما با کمرنگ شدن مرز میان انسان و ماشینهای آنلاین، تفاوت میان عقایدی که توسط گروه بزرگی از انسانها یا سیستمهای مدکام ساخته شده باشد قابل تشخیص نخواهد بود.

کنگره آمریکا به تازگی لایحهای مبنی بر مقابله با پروپاگاندای خارجی و اطلاعرسانی غلط را بررسی کرده بود، ولی با تکامل انقلاب هوش مصنوعی، شاید نیازمند شفافیت بیشتری در زمینه اطلاعات باشیم، اطلاعاتی که تا پیش از این همیشه توسط خود انسانها فراهم میشد.

ناشناختهها همیشه عاملی برای وحشت بشر بودهاند. برخلاف ریسکهایی که در بالا به آنها اشاره کردیم، بزرگترین و سادهترین ریسک این است که از اتفاقات پیرامون خود غافل شویم. گروه بزرگی از توسعهدهندگان با وظایف مشخص، مثل یک ارگانیزم چندسلولی، مشغول ارسال اطلاعات ما به سیستمهای ابری هستند، سیستمی که به ما نیاز نداشته باشد.

هوش مصنوعی اولین برنامهای است، که اگر به موفقیت برسد، چیزی هوشمندانهتر از خود ما خواهد بود. برنامههایی مثل OpenAI.com به دنبال ایجاد الگوریتمهایی برای پاسخگویی به مسئله هوش عمومی هستند. اکثر مردم میخواهند جلوی این کارها گرفته شود تا ریسکها از بین برود، ولی آنها نمیدانند که کشتی پیشرفت از مدتها پیش بادبان خود را کشیده است.

هوشمندانهترین کاری که از دست ما بر میآید این است که خودمان را آگاه کنیم. ضربالمثل معروفی که میگفت «دشمنانت را نزدیکتر نگه دار» درست است، چون اگر فقط چند شرکت در زمینه تحقیقات AI فعالیت داشته باشند، همانها به تنهایی سرنوشت هوش مصنوعی را برای همه ما رقم میزنند. مطالعه درباره هوش مصنوعی بهترین اقدام ممکن برای مقابله با ریسکهای موجود است. باید درباره این «برق جدید» حرف بزنیم و بقیه را نسبت به آن آگاه کنیم.